AnythingLLM是由Mintplex Labs Inc.开发的一款全栈应用程序。该程序能够将任何文档、资源(如网址链接、音频、视频)或内容片段转换为个人知识库,供大语言模型(LLM)在聊天过程中作为参考。AnythingLLM不仅支持多用户管理和权限设置,还允许用户灵活选择使用不同的大语言模型和向量数据库,从而满足个性化的需求。

AnythingLLM的特点包括高度可配置性、多用户支持以及强大的文档处理能力。它可以将用户的文档划分为称为“workspaces”的工作区,每个工作区可以独立管理文档,并保持上下文的清晰,不会互相干扰。此外,AnythingLLM提供两种聊天模式:对话模式和查询模式。对话模式会提供对话的上下文给大模型,方便用户回顾和继续交流;查询模式则专注于对文档的简单问答交互,不会与上文关联。

AnythingLLM高度重视用户数据的隐私与安全。所有文档和信息都存储在本地机器上,与其他实例隔离,确保数据不会泄露或与其他用户共享。

AnythingLLM自带嵌入引擎提供商(实现文档向量化),因此不需要自己安装词嵌入模型(dmeta-embedding-zh等)。

其核心方法是,AnythingLLM+离线大语言模型,或AnythingLLM+云端大模型。

方式一:通过AnythingLLM的LLM首选项直接下载离线大语言模型

- 1.安装AnythingLLM

访问AnythingLLM官网可一键下载客户端安装包。AnythingLLM官网

安装时,注意别安装在C盘。

- 2.下载配置大模型

AnythingLLM提供了众多模型供应商进行选择,其中完全本地运行的离线模型则需要下载。

打开AnythingLLM,点扳手图标(设置),在“大语言模型(LLM)”中,LLM提供商保持“AnythingLLM”不变,在下面点选Alibaba的“Qwen3 4b”或Google的“Gemma3 4b”等模型中的一个,然后点“Save Changes”,即开始下载大模型。

- 3.新建并使用知识库

大模型下载完成后,在左侧搜索框旁点“+”新建一个工作区(知识库)。每个工作区可建立成不同的知识库。

然后点新工作区右边的上传按钮,即可上传自有本地文档。上传文档并向量化成功后,就可以询问大模型知识库中的内容了。

点“New thread”,可基于该知识库新建一个对话区,围绕一个话题进行连贯的上下文对话。

点工作区(知识库)右边的齿轮图标(设置),在“聊天设置/聊天模式”中,可设置为聊天或查询模式,聊天将提供LLM的一般知识和找到的文档上下文的答案;查询将会提供答案仅当找到文档上下文时。

方式二:通过Ollama本地部署大语言模型

1.本地部署Ollama

Ollama是一个极简的本地大模型运行框架,首先安装它,是需要用它来下载并管理本地模型。

-

官网下载Ollama。ollama.com

-

完成指定目录安装。Ollama默认安装在C盘,后续大模型也安装在C盘,要改变Ollama安装目录,可按Windows图标键+R,输入“cmd”回车,在CMD窗口输入:

OllamaSetup.exe /DIR=D:\Ollama (“D:\Ollama”即自已指定的目录)然后Ollama就会进入安装,点击“Install”后,可以看到Ollama的安装路径就变成了我们指定的目录了,这样大模型数据包也会默认下载在指定目录中。

- 安装成功后,Ollama会启动并进入chat窗口,这时可以用云端大模型进行问答了。后面部署本地模型后,选择相应本地模型,就可以进行本机调用问答。

2.本地部署大语言模型(Deepseek R1或千问3、Gemma3)

选择其体的大语言模型,主要看自己计算机的内存大小,模型体量(有多少G)大于内存容量,就会运行不了。一般模型的G数,占内存+显存G数的一半左右,较为合适。

Deepseek

在Ollama官网,搜索“deepseek-r1”,搜出结果中,可看到各Models的大小,deepseek-r1:1.5b是Deepseek R1中最小的,但生成效果一般。下载安装的CMD命令为:

ollama run deepseek-r1:1.5b千问3

在Ollama官网,搜索“qwen3”,搜出结果中,可看到各Models的大小,千问3 4b只有2.5G大小,比较适中。下载安装的CMD命令为:

ollama run qwen3:4bgemma3

ollama run gemma3:4b大模型安装完成后,可以在CMD中直接与其对话一下,进行个测试。

3.LLM提供商选“Ollama”、"Ollama Model"选deepseek-r1:1.5b

打开AnythingLLM,点扳手图标(设置),在“大语言模型(LLM)”中,LLM提供商选“Ollama”,"Ollama Model"选“deepseek-r1:1.5b(或qwen3:4b、gemma3:4b)”。

引外,还可以单独为点工作区(知识库)设定LLM提供商,点工作区右边的齿轮图标(设置),在“工作区LLM 提供者”中,选“Ollama”,"Ollama Model"选“deepseek-r1:1.5b(或qwen3:4b、gemma3:4b)”。

方式三:调用云端大模型

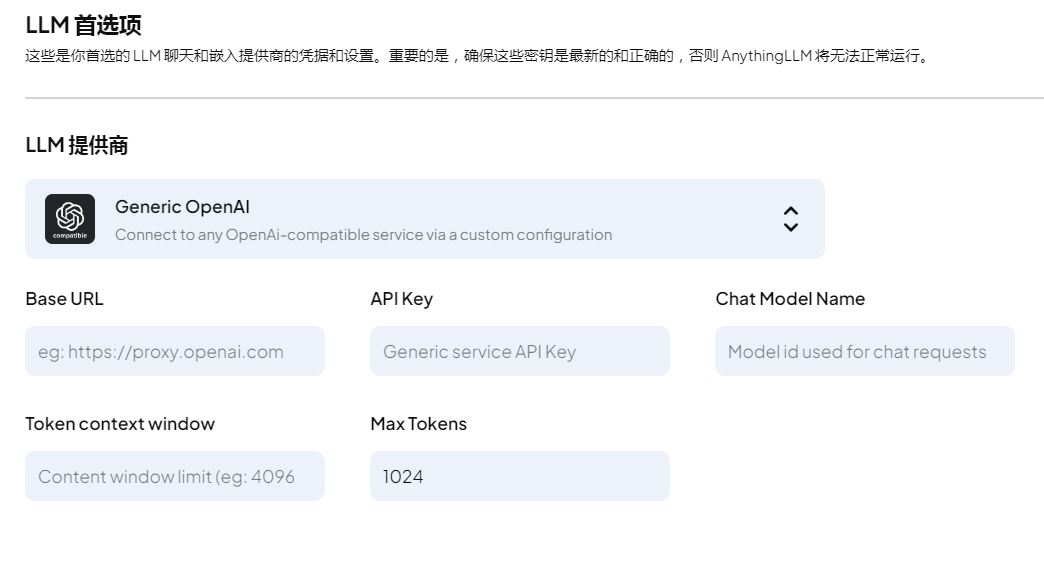

由于本地模型有算力、参数规模等限制,要想使用更智能的模型还是需要用到API来调用云端大模型,这里选择“Generic OpenAl”为模型提供商,可以使用由OpenDatasky提供的全球顶级大模型,如GPT、Claude系列。(具体支持的模型请参考OpenDatasky官方API文档)

通过API密钥直连商业大模型

AnythingLLM支持直接接入OpenAI、Claude、Gemini等商业大模型的API服务。用户只需在系统设置中创建API密钥,并配置模型参数即可实现无缝对接。以OpenAI为例,用户需在“LLM首选项”中选择“Generic OpenAI”作为提供商,输入API密钥及模型名称,系统将自动调用云端模型完成推理。这种方式的显著优势在于无需维护本地硬件,即可获得高算力支持,尤其适合处理大规模文本生成任务。

利用中间件平台实现模型聚合